Die KI-Akademie erforscht unter anderem, wie nutzbar, fair und hilfreich KI-Systeme sind, wenn Menschen mit ihnen interagieren. Besonders spannend wird das, wenn diese Systeme nicht neutral, sondern vorgeprägt oder verzerrt sind.

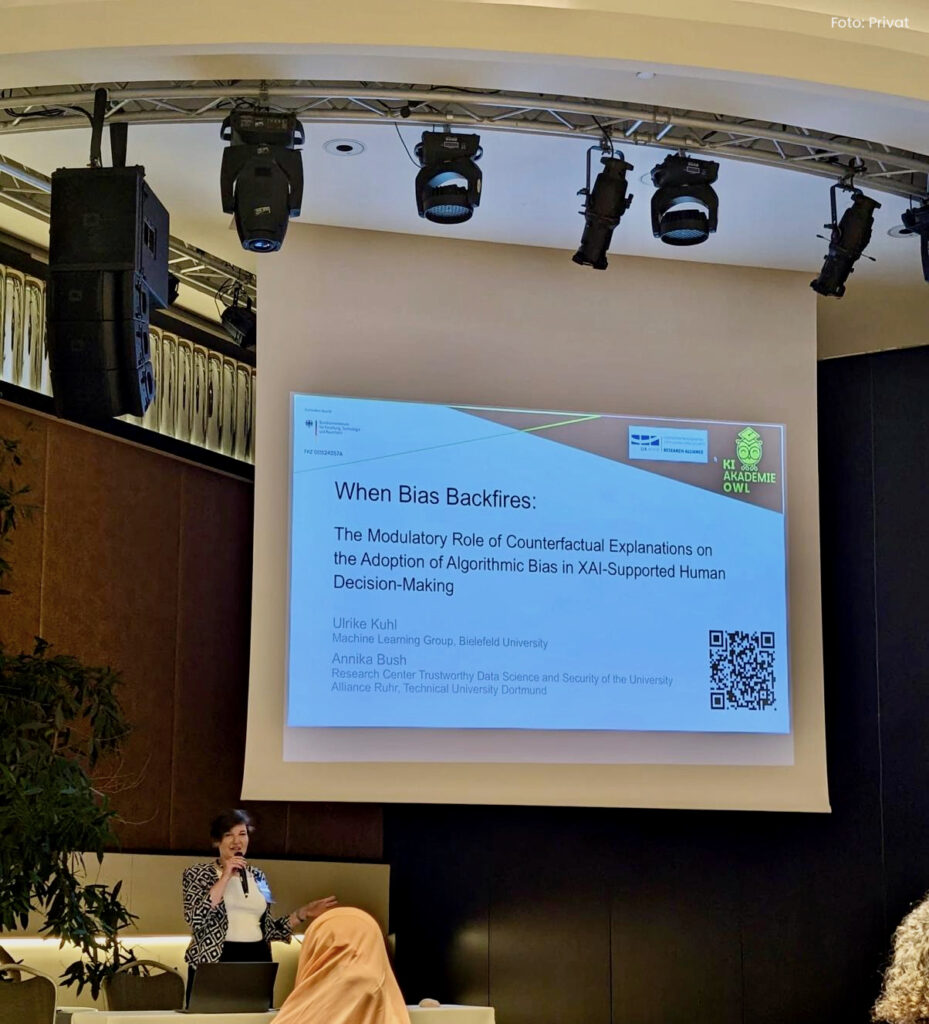

Auf der diesjährigen 3rd World Conference on eXplainable AI, die vom 09-11. Juli in Istanbul stattfand, stellte unsere Kollegin Ulrike Kuhl aktuelle Forschungsergebnisse in diesem Bereich vor.

Ihre Studie zeigte insgesamt, dass Proband*Innen den Empfehlungen eines KI-Systems nicht stärker oder schwächer folgten, egal ob das System seine Empfehlungen erklärt oder nicht.

Spannend wurde es jedoch beim Verhalten der Nutzer*Innen nach der KI-Interaktion: Erklärungen lösen eine Art Gegenreaktion aus, und ändern so das Verhalten von Menschen.

Diese Forschung führt zu spannenden Diskussionen rund um die Frage: Wie können Erklärungen und KI-Systeme so gestaltet werden, dass sie unterstützen, ohne zu manipulieren?